Le connexionnisme, ou informatique neuronale, est né des tentatives de compréhension du fonctionnement du cerveau humain au niveau neuronal et, en particulier, de la manière dont les gens apprennent et se souviennent. En 1943, le neurophysiologiste Warren McCulloch de l’université de l’Illinois et le mathématicien Walter Pitts de l’université de Chicago ont publié un traité influent sur les réseaux neuronaux et les automates, selon lequel chaque neurone du cerveau est un simple processeur numérique et le cerveau dans son ensemble est une forme de machine à calculer. Comme l’a dit McCulloch par la suite, « Ce que nous pensions faire (et je pense que nous avons assez bien réussi) était de traiter le cerveau comme une machine de Turing. »

[Lire: Alan Turing]

Création d’un réseau neuronal artificiel

Ce n’est qu’en 1954, cependant, que Belmont Farley et Wesley Clark du MIT ont réussi à faire fonctionner le premier réseau neuronal artificiel, bien que limité par la mémoire de l’ordinateur à 128 neurones au maximum. Ils sont parvenus à entraîner leurs réseaux à reconnaître des modèles simples. En outre, ils ont découvert que la destruction aléatoire de jusqu’à 10 % des neurones d’un réseau entraîné n’affectait pas les performances du réseau – une caractéristique qui rappelle la capacité du cerveau à tolérer des dommages limités infligés par une chirurgie, un accident ou une maladie.

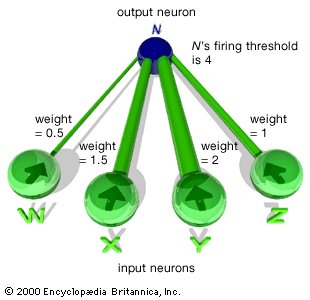

Le réseau neuronal simple représenté sur la figure illustre les idées centrales du connexionnisme. Quatre des cinq neurones du réseau sont destinés à l’entrée, et le cinquième – auquel chacun des autres est connecté – est destiné à la sortie. Chacun des neurones est soit actif (1), soit inactif (0). Chaque connexion menant à N, le neurone de sortie, possède un « poids ». Ce que l’on appelle l’entrée pondérée totale dans N est calculée en additionnant les poids de toutes les connexions menant à N à partir des neurones qui fonctionnent. Par exemple, supposons que seuls deux des neurones d’entrée, X et Y, fonctionnent. Comme le poids de la connexion de X à N est de 1,5 et que le poids de la connexion de Y à N est de 2, il s’ensuit que l’entrée pondérée totale de N est de 3,5. Comme le montre la figure, le seuil de déclenchement de N est de 4. En d’autres termes, si l’entrée pondérée totale de N est égale ou supérieure à 4, N se déclenche ; sinon, N ne se déclenche pas. Ainsi, par exemple, N ne se déclenche pas si les seuls neurones d’entrée à se déclencher sont X et Y, mais N se déclenche si X, Y et Z se déclenchent tous.

L’entraînement du réseau se fait en deux étapes. Premièrement, l’agent externe introduit un modèle et observe le comportement de N. Deuxièmement, l’agent ajuste les poids des connexions conformément aux règles :

Si la sortie réelle est 0 et la sortie souhaitée est 1, augmenter d’une petite quantité fixe le poids de chaque connexion menant à N à partir de neurones qui s’activent (ce qui rend plus probable l’activation de N la prochaine fois que le réseau reçoit le même modèle) ;

Si la sortie réelle est 1 et la sortie souhaitée est 0, diminuez de la même petite quantité le poids de chaque connexion menant au neurone de sortie à partir des neurones qui se déclenchent (ce qui rend moins probable le déclenchement du neurone de sortie la prochaine fois que le réseau reçoit ce modèle en entrée).

L’agent externe – en fait un programme informatique – suit cette procédure en deux étapes pour chaque motif d’un échantillon d’apprentissage, qui est ensuite répété un certain nombre de fois. Au cours de ces nombreuses répétitions, un modèle de poids de connexion se forge qui permet au réseau de répondre correctement à chaque modèle. Ce qui est frappant, c’est que le processus d’apprentissage est entièrement mécanique et ne nécessite aucune intervention ou ajustement humain. Les poids de connexion sont augmentés ou diminués automatiquement d’une quantité constante, et la même procédure d’apprentissage s’applique exactement à différentes tâches.

[Lire: Qu’est-ce que l’intelligence artificielle]

Perceptrons

En 1957, Frank Rosenblatt, du laboratoire aéronautique de l’université Cornell à Ithaca (New York), a commencé à étudier les réseaux neuronaux artificiels qu’il a appelés perceptrons. Il a apporté des contributions majeures au domaine de l’IA, à la fois par des recherches expérimentales sur les propriétés des réseaux neuronaux (à l’aide de simulations informatiques) et par une analyse mathématique détaillée. Rosenblatt était un communicateur charismatique, et de nombreux groupes de recherche ont rapidement étudié les perceptrons aux États-Unis. Rosenblatt et ses disciples ont appelé leur approche connexionniste pour souligner l’importance dans l’apprentissage de la création et de la modification des connexions entre les neurones. Les chercheurs modernes ont adopté ce terme.

L’une des contributions de Rosenblatt a été de généraliser la procédure de formation que Farley et Clark avaient appliquée à des réseaux à deux couches seulement, afin de pouvoir l’appliquer à des réseaux multicouches. Rosenblatt a utilisé l’expression « correction d’erreurs par rétropropagation » pour décrire sa méthode. La méthode, avec des améliorations et des extensions substantielles par de nombreux scientifiques, et le terme de rétropropagation sont maintenant d’usage courant dans le connexionnisme.

[Lire: L’intelligence artificielle et l’apprentissage automatique]

Conjugaison des verbes

Dans une célèbre expérience connexionniste menée à l’Université de Californie à San Diego (publiée en 1986), David Rumelhart et James McClelland ont entraîné un réseau de 920 neurones artificiels, disposés en deux couches de 460 neurones, à former les temps du passé des verbes anglais. Les formes de base des verbes, comme come, look et sleep, étaient présentées à une couche de neurones, la couche d’entrée. Un programme informatique de supervision observait la différence entre la réponse réelle au niveau de la couche de neurones de sortie et la réponse souhaitée, par exemple « viens », puis ajustait mécaniquement les connexions dans l’ensemble du réseau, conformément à la procédure décrite ci-dessus, afin de donner au réseau une légère impulsion en direction de la réponse correcte. Environ 400 verbes différents ont été présentés un par un au réseau, et les connexions ont été ajustées après chaque présentation. Cette procédure a été répétée environ 200 fois en utilisant les mêmes verbes, après quoi le réseau a pu former correctement le passé de nombreux verbes inconnus ainsi que des verbes originaux. Par exemple, lorsqu’on lui a présenté pour la première fois guard, le réseau a répondu guarded ; weep, wept ; cling, clung ; et drip, dripped (avec un double p). Il s’agit d’un exemple frappant d’apprentissage impliquant une généralisation. (Parfois, cependant, les particularités de l’anglais étaient trop importantes pour le réseau, et il a formé squawked à partir de squat, shipped à partir de shape, et membled à partir de mail).

Un autre nom pour le connexionnisme est le traitement distribué parallèle, qui met l’accent sur deux caractéristiques importantes. Premièrement, un grand nombre de processeurs relativement simples – les neurones – fonctionnent en parallèle. Deuxièmement, les réseaux neuronaux stockent les informations de manière distribuée, chaque connexion individuelle participant au stockage de nombreux éléments d’information différents. Le savoir-faire qui a permis au réseau du passé de former pleurer à partir de pleurer, par exemple, n’était pas stocké à un endroit précis du réseau, mais était réparti sur l’ensemble du modèle de poids des connexions qui a été forgé pendant la formation. Le cerveau humain semble également stocker des informations de manière distribuée, et la recherche connexionniste contribue aux tentatives de comprendre comment il le fait.

Autres réseaux neuronaux

D’autres travaux sur le calcul de type neuronal sont présentés ci-dessous :

La perception visuelle. Les réseaux peuvent reconnaître des visages et d’autres objets à partir de données visuelles. Un réseau neuronal conçu par John Hummel et Irving Biederman à l’université du Minnesota peut identifier une dizaine d’objets à partir de simples dessins au trait. Le réseau est capable de reconnaître les objets – dont une tasse et une poêle à frire – même s’ils sont dessinés sous des angles différents. Les réseaux étudiés par Tomaso Poggio, du MIT, sont capables de reconnaître des formes en fil de fer coudé dessinées sous différents angles, des visages photographiés sous différents angles et présentant différentes expressions, ainsi que des objets provenant de dessins animés avec des nuances de gris indiquant la profondeur et l’orientation.

[Lire: Apprendre aux robots à penser comme nous]

Traitement du langage. Les réseaux neuronaux sont capables de convertir des documents manuscrits et dactylographiés en texte électronique. L’Internal Revenue Service des États-Unis a commandé un système neuronal qui lira automatiquement les déclarations d’impôts et la correspondance. Les réseaux neuronaux convertissent également la parole en texte imprimé et le texte imprimé en parole.

L’analyse financière. Les réseaux neuronaux sont de plus en plus utilisés pour l’évaluation des risques liés aux prêts, l’évaluation des biens immobiliers, la prévision des faillites, la prévision du prix des actions et d’autres applications commerciales.

La médecine. Les applications médicales comprennent la détection des nodules pulmonaires et des arythmies cardiaques, ainsi que la prédiction des effets indésirables des médicaments.

Les télécommunications. Les applications des réseaux neuronaux dans le domaine des télécommunications comprennent le contrôle des réseaux de commutation téléphonique et l’annulation de l’écho dans les modems et sur les liaisons par satellite.

SEO Inside est une agence web.

--

SEO Inside est une agence web et SEO - en savoir plus sur nous:

Agence web / Audit SEO / Conseil SEO / Création de site internet / Refonte de site internet optimisé pour le SEO / Référencement naturel / Référencement local /Netlinking / Formation SEO / E-Réputation et avis

Voici nos implantations :

Lille / Dunkerque / Amiens – ce sont nos 3 bureaux historiques.

Puis voici nos zones géographiques d’intervention :

Paris / Abbeville / Rouen / Compiègne / Reims / Metz / Caen / Evreux / Nancy / Colmar / Rennes / Le Mans / Orléans / Dijon / Besançon / Angers / Nantes / La Rochelle / Poitiers / Limoges /Clermont-Ferrand / Lyon / Annecy / Grenoble / Valence / Bordeaux / Montauban / Toulouse / Biarritz / Montpellier / Marseille / Cannes / Nice / Avignon / Monaco

SEO INSIDE est une agence web spécialiste en référencement naturel qui se veut proche de vous. Contactez-nous pour discuter de vos projets.